A mesterséges intelligencia az utóbbi időben hatalmas fellendülést él át. Mindenki annyira izgatott ettől a technológiától, hogy fel sem fogja, milyen kockázatokkal járhat a jövőben. Az AI-szakértők jelenleg megkongatják a vészharangot, és arra figyelmeztetnek, hogy a vállalatoknak el kellene kezdeniük foglalkozni a kockázatokkal, mielőtt túl késő lenne.

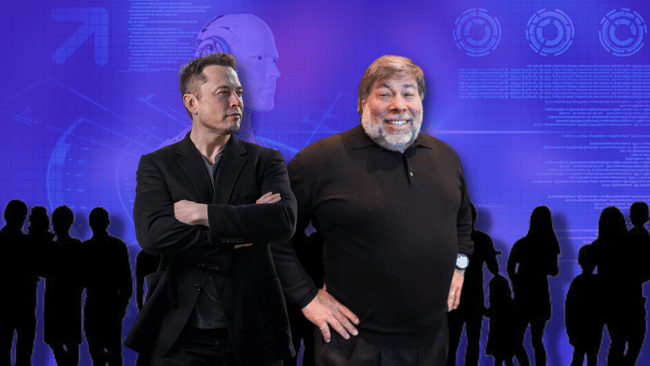

A mesterséges intelligencia (MI) szakértői a közelmúltban "Szüneteltessük a gigantikus MI-kísérleteket: nyílt levél" címmel nyílt levélben szólítják fel a területen dolgozó vállalatokat, hogy ideiglenesen állítsák le a generatív MI-rendszerek fejlesztését. A levél, amelyet több mint 1000 ember, köztük Elon Musk, Steve Wozniak, Evan Sharp, Craig Peters és Yoshua Bengio írt alá, rávilágít arra, hogy a fejlesztések eredményeinek lehetséges jövőbeli hatásait illetően bizonytalan a helyzet.

A levélben a szakértők hat hónapos szünetet javasolnak a mesterséges intelligencia technológiájának biztonságos fejlesztését szolgáló szabályozási politikák és eljárások kidolgozására. A szünetnek csak az OpenAI által kifejlesztett GPT-4 generatív AI-modellnél erősebb AI-rendszerek képzésére kellene vonatkoznia. Ha a szakértők felhívását nem hallgatják meg, a levél azt javasolja, hogy a kormányok moratóriumot rendeljenek el.

A generatív mesterséges intelligencia és a kapcsolódó technológiák fejlesztésébe befektető vállalatok között olyan óriáscégek vannak, mint a Microsoft $MSFT, az Alphabet $GOOGL, az Alibaba $BABA és a Baidu $BIDU. A szakértők levele biztonsági protokollokat, valamint a pozitív hatások és a kockázatok kezelhetőségének biztosítását követeli. A levél eredménye azt eredményezheti, hogy a vállalatok vagy leállnak és új politikákat alakítanak ki, vagy legalábbis átgondolják a lehetséges hatásokat és megteszik a szükséges intézkedéseket.

A GPT-4 mint a lehetséges problémák kiváltó oka

A nemrégiben bevezetett GPT-4 lenyűgözte a felhasználókat a beszélgetés, a dalszövegírás és a hosszú dokumentumok összefoglalása terén mutatott képességeivel. A modellre adott reakciók arra késztették a versenytársakat, például az Alphabet Inc-t, hogy felgyorsítsák a hasonló nagyméretű nyelvi modellek fejlesztését. A mesterséges intelligencia szakértői azonban a fejlesztés lassítására szólítanak fel, amíg jobban meg nem értjük a következményeket és a társadalomra gyakorolt potenciális károkat.

A Future of Life Institute, egy elsősorban a Musk Foundation, a londoni székhelyű Founders Pledge csoport és a Szilícium-völgyi Közösségi Alapítvány által finanszírozott nonprofit szervezet, amely nyílt levelet adott ki, úgy véli, hogy csak akkor szabad nagy teljesítményű mesterséges intelligencia rendszereket fejleszteni, ha biztosak vagyunk abban, hogy hatásuk pozitív, kockázataik pedig kezelhetőek lesznek. A szervezet egy szabályozó testület létrehozását is szorgalmazza, amely biztosítaná, hogy a mesterséges intelligencia fejlesztése a közérdeket szolgálja.

Elon Musk, az OpenAI társalapítója és a levelet aláíró szakértők egyike ismert arról, hogy figyelmeztet a mesterséges intelligencia fejlesztésével kapcsolatos lehetséges kockázatokra. Szerinte elengedhetetlen a független szakértők által kidolgozott közös biztonsági protokollok létrehozása, és sürgeti a fejlesztőket, hogy működjenek együtt a politikai döntéshozókkal az irányítás terén.

Az OpenAI ügyvezető igazgatója, Sam Altman, valamint az Alphabet és a Microsoft vezérigazgatói, Sundar Pichai és Satya Nadella nem voltak a nyílt levél aláírói között. A levél mindazonáltal fontos lépés afelé, hogy megkezdődjön a vita a mesterséges intelligencia jövőjéről és az általa jelentett lehetséges kockázatokról.

A levél lehetséges következményei

A levélnek több lehetséges következménye is lehet. Az egyik, hogy a mesterséges intelligencia fejlesztésében részt vevő vállalatok és kutatóintézetek átmenetileg leállíthatják tevékenységüket és átgondolhatják gyakorlatukat. Ez a forgatókönyv lehetővé tenné a szakértők és a szabályozók számára, hogy áttekintsék az eddigi fejleményeket, és megtegyék a szükséges intézkedéseket a biztonság és a fenntarthatóság biztosítása érdekében a mesterséges intelligencia területén.

Másik lehetőség, hogy a levél hatására jobban tudatosulnának a mesterséges intelligencia fejlesztésével kapcsolatos potenciális kockázatok, valamint a biztonsági protokollok és szabályozási eljárások kialakításának szükségessége. Ez lehetővé tenné a vállalatok számára, hogy nagyobb hangsúlyt fektessenek a biztonságosabb és etikusabb AI-rendszerek létrehozására, amelyek pozitív hatást gyakorolnak a társadalomra.

Végül a levél arra ösztönözheti a kormányokat és a nemzetközi szervezeteket, hogy fontolják meg szabályozási intézkedések és moratóriumok bevezetését a mesterséges intelligencia fejlesztésére. Ez biztosítaná, hogy a mesterséges intelligencia fejlesztése a társadalom érdekeinek megfelelően történjen, és a lehetséges negatív hatásokat a lehető legkisebbre csökkentsék.

A nyílt levél eredményétől függetlenül egyértelmű, hogy a mesterséges intelligencia fejlesztésének biztonságáról és etikájáról szóló vita egyre sürgetőbbé válik. Mivel a GPT-4-hez hasonló mesterséges intelligencia-rendszerek egyre inkább megjelennek a mindennapi életben, arra kell összpontosítani, hogy miként lehet ezeket a technológiákat a társadalom javára használni anélkül, hogy az egyének magánéletének, biztonságának vagy érdekeinek veszélyeztetésével járna.

Az egyik példa arra, hogy a mesterséges intelligencia-rendszerek hogyan használhatók a közjó érdekében, a GPT-4 alkalmazása környezeti, egészségügyi vagy gazdasági problémák megoldására. Másrészt fontos figyelembe venni a lehetséges kockázatokat, például a technológiával való visszaélést a félretájékoztatás terjesztésére, a közvélemény manipulálására vagy a technológiához való hozzáférés egyenlőtlenségének növelésére.

A "Szüneteltessük az óriási mesterséges intelligenciakísérleteket" című nyílt levél felhívás arra, hogy gondolkodjunk el a mesterséges intelligencia fejlődésének útjáról. Továbbra is kérdéses, hogy sikerül-e konszenzusra jutni a szakértők, a vállalatok és a kormányok között. Fontos azonban, hogy a tudósok, az iparági vezetők és a politikai döntéshozók arra összpontosítsanak, hogy közösen keressék a módját annak, hogyan lehet az emberiség érdekeit szolgáló mesterséges intelligencia-fejlesztést biztosítani és szabályozni.

FIGYELEM: Nem vagyok pénzügyi tanácsadó, és ez az anyag nem szolgál pénzügyi vagy befektetési ajánlásként. Az anyag tartalma pusztán tájékoztató jellegű.